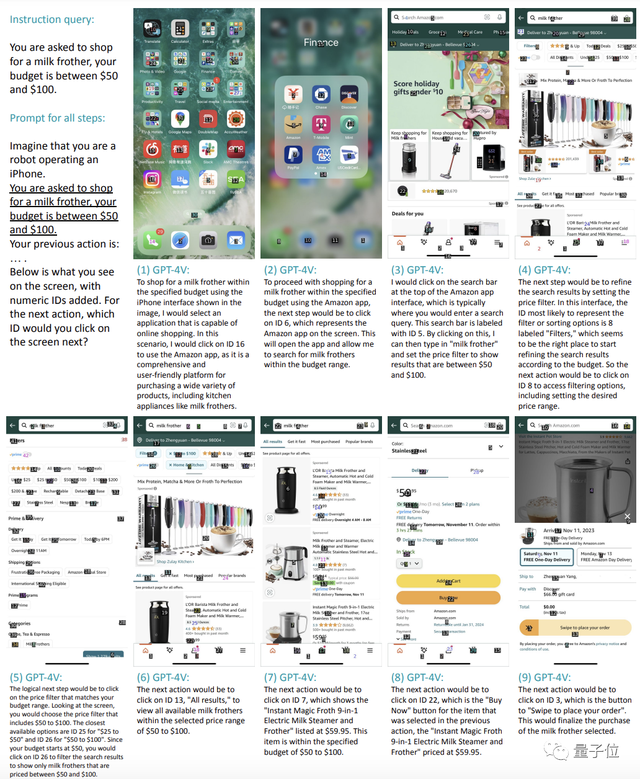

最新研究揭示:GPT-4V不仅能够零训练地与智能手机互动,还能像人类一样执行各种指令,令人惊叹。例如,只需告诉它在50-100美元的预算内购买一个打奶泡的工具,它就能像魔术师一样完成购物流程,从亚马逊选择商品、设定预算、下单,共计9个步骤。

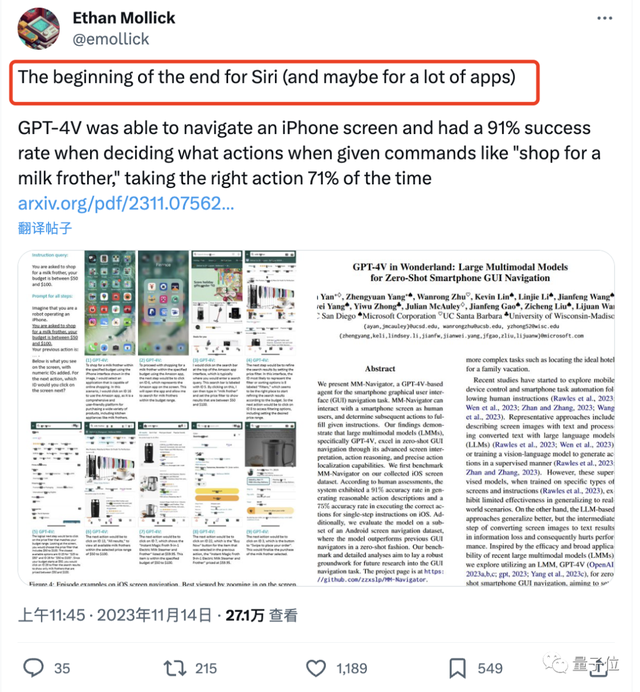

经测试,GPT-4V在iPhone上执行类似任务的成功率高达75%。这让人不禁想象,随着这一技术的崛起,Siri可能面临着被淘汰的危机,因为GPT-4V对iPhone的理解能力超越了传统语音助手。

然而,有人对此嗤之以鼻,认为Siri一开始就没这么强大。这引发了一场关于语音交互未来的热议,有人甚至预测智能手机可能演变成纯粹的显示设备。

这项研究由加州大学圣地亚哥分校和微软等机构共同推动。他们开发了一个名为MM-Navigator的代理工具,基于GPT-4V,用于导航智能手机用户界面。

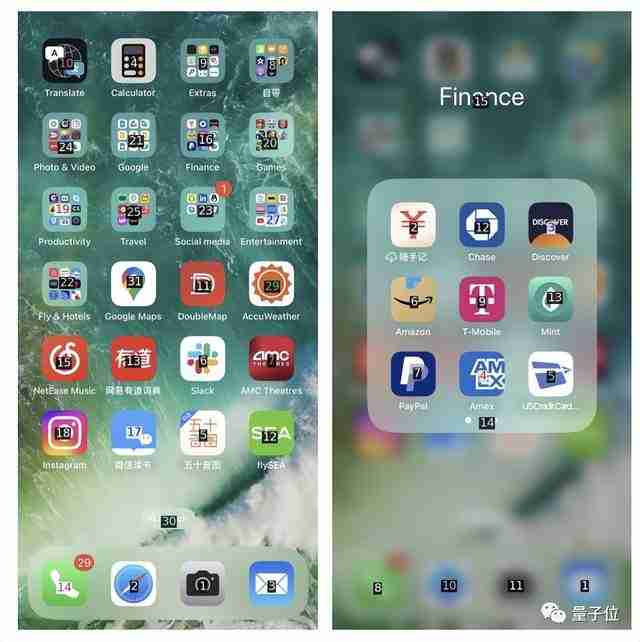

实验中,MM-Navigator在每个时间步骤都会获得屏幕截图。作为多模态模型,GPT-4V接受图像和文本输入,并生成文本输出。解决模型对准确位置坐标的计算问题,作者采用了OCR工具和IconNet,标记屏幕上的UI元素。

两组能力测试揭示GPT-4V在语义推理和本地化动作执行方面的表现。在预期动作描述任务中,GPT-4V准确率高达90.9%。然而,在具体执行动作的本地化测试中,准确率下降至74.5%。

实验还包括在安卓手机上的测试,整体表现明显优于其他模型。这项研究证明了多模态模型如GPT-4V在未知场景中直接迁移能力的潜力,为手机交互带来了巨大的可能性。

网友对研究提出了两个关键问题:如何定义任务执行的成功与否,以及商用这项技术尚需跨越不小障碍。毕竟,即使准确率高达95%的Siri也经常受到用户吐槽。

这项研究由12位作者完成,大部分来自微软,其中加州大学圣地亚哥分校的博士生An Yan和微软的高级研究员Zhengyuan Yang共同为第一作者。他们的创新推动了智能手机交互的新时代。